Trwa kampania społeczna „NGO bez barier” w ramach projektu pt. „Lubelscy Liderzy Dostępności”, sfinansowanego przez Narodowy Instytut Wolności – Centrum Rozwoju Społeczeństwa Obywatelskiego ze środków Programu Fundusz Inicjatyw Obywatelskich NOWEFIO na lata 2021–2030. Projekt jest realizowany przez Związek Stowarzyszeń Forum Lubelskich Organizacji Pozarządowych. Celem projektu jest wzmocnienie pod względem strategicznym rozwoju Lubelskiego Partnerstwa na Rzecz Dostępności (LPnRD), które jest płaszczyzną współpracy na rzecz zapewnienia dostępności osobom ze szczególnymi potrzebami w woj. lubelskim.

Nie żyjemy po to – aby jeść, ale jemy po to – aby żyć

Nie rozwijamy technologii AI dla niej samej – lecz po to, aby służyła ludziom. Sztuczna inteligencja nie ma świadomości, ani wiedzy w ludzkim sensie. To, co wie, zależy wyłącznie od tego czym ją nakarmimy. AI można porównać do ogromnej kuchni pełnej danych. Kucharz nie ma smaku, ani nie wie – co jest dobre, a co niestrawne. Ale jeśli człowiek poda mu przepis i odpowiednie składniki, to będzie potrafił przygotować danie – które wszystkich zaskoczy smakiem i wyrachowaniem. Tak samo działa AI, w zależności od tego – jakimi danymi ją nakarmimy. Nie wystarczy wyposażyć AI w mega szybką moc obliczeniową – trzeba zadbać o odpowiednie menu. Tak jak w przypadku człowieka, jakość pożywienia decyduje – o sile i zdrowiu. Stąd nowego znaczenia nabierają słowa – spiesz się powoli, jak też – co za dużo, to niezdrowo. Należy też pamiętać, że nie ma darmowych obiadów.

Ważny jest też podział odpowiedzialności w kuchni – kogo postawimy przy kuchennym blacie? Kto za co odpowiada – czy decyzja zawsze należy do szefa kuchni, czy też AI ma autonomię w określonym zakresie? Skąd AI ma wiedzieć, co robić? Bez tego wdrożenie nawet najbardziej przydatnej technologii napotka opór. Kolejna kwestia dotyczy odpowiedzialności. Kto poniesie konsekwencję, jeżeli AI podejmie błędną decyzję? Odpowiedź kryje się w procesie zwanym trenowaniem AI. Trening pozwala przekształcić surowe dane w praktyczną wiedzę, którą można wykorzystać w różnych dziedzinach życia.

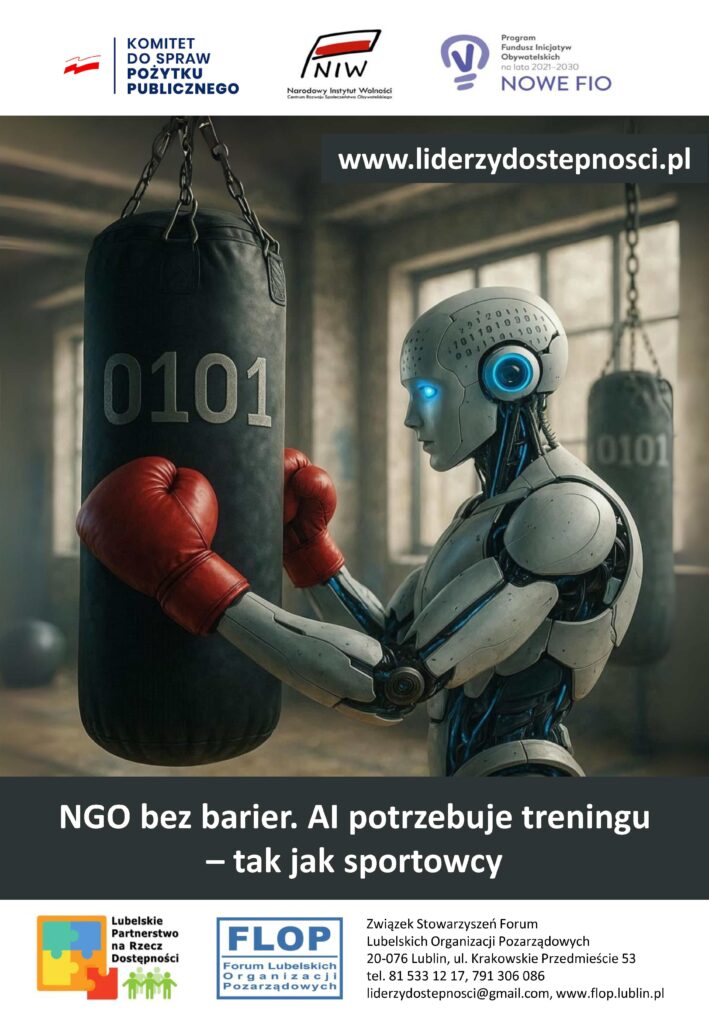

AI – sportowiec mimo woli

Sport i sztuczną inteligencję łączy więcej, niż mogłoby się wydawać. Kiedy patrzymy na sportowca w szczytowej formie, często dostrzegamy jedynie efekt końcowy – medal i rekord. To, czego zwykle nie widzimy, to miesiące i lata systematycznych ćwiczeń, przygotowań i stopniowego doskonalenia umiejętności. Podobnie jest ze sztuczną inteligencją. Klasyczne oprogramowanie komputerowe opiera się na precyzyjnych instrukcjach typu – zrób to w ten sposób. W przypadku AI logika jest inna – program uczy się na podstawie udostępnionych danych, doświadczeń i interakcji. AI nie ćwiczy mięśni, lecz algorytmy. Zamiast boiska, czy siłowni – ma dostęp do ogromnych zbiorów danych. W efekcie mamy do czynienia nie z prostym narzędziem AI, ale systemem zdolnym do – adaptacji, przewidywania i samodoskonalenia.

AI wskazuje drogę, ale to człowiek powinien wybierać kierunek. W uproszczeniu trenowanie AI to jak nauka w oparciu o doświadczenie, tylko w znacznie szybszym tempie i na większą skalę. Istnieją także podobieństwa w samej strukturze treningu. Ćwiczenie czyni mistrza. Sportowiec nie może uczyć się wszystkiego naraz – trening rozkładany jest na etapy, cykle i specjalizacje. Najpierw podstawy, potem coraz bardziej skomplikowane techniki. Tak samo wygląda rozwój modeli AI – najpierw uczą się prostych zależności, stopniowo przechodząc do zadań złożonych.

Trenowanie AI wymaga dużej mocy obliczeniowej i czasu

Skuteczność systemów opartych na AI w dużej mierze zależy od jakości i odpowiedniej ilości danych wykorzystywanych w procesie uczenia się. AI nie posiada własnej wyobraźni ani emocji – korzysta wyłącznie z danych jakie zostaną mu udostępnione. Dlatego jej twórczość jest przetwarzaniem istniejących wzorców, a nie aktem natchnienia. Zbiory mogą być pozyskane w różny sposób – z istniejących źródeł, tworzone przy użyciu symulacji, czy poprzez zakup danych od zewnętrznych komercyjnych dostawców. Jakość danych jest jednym z najważniejszych czynników wpływających na skuteczność i wiarygodność AI.

AI uczy się na podstawie dostępnych zbiorach danych, a te mogą być zawodne – zawierać stereotypy i uprzedzenia. Kolejnym krokiem będzie proces przetwarzania zbioru danych w formacie, który AI potrafi analizować. Następnie model AI uczy się wzorców – sprawdza, jak różne cechy wpływają na wynik i dostosowuje się do nich. Poprawia błędy ucząc się na własnych pomyłkach, aby poprawić dokładność. Zjawisko emergencji pojawia się, gdy duże modele językowe AI trenowane na ogromnych ilościach danych – wykazują nowe umiejętności, których nie mają mniejsze modele.

Sportowiec potrzebuje trenera, który wskaże błędy, zmotywuje i dostosuje plan treningowy. Dla AI taką rolę pełnią programiści – to oni dobierają dane, projektują architekturę modeli, monitorują wyniki i korygują błędy. Tak jak źle dobrany trening może prowadzić do kontuzji, tak źle przygotowane dane mogą skutkować błędnymi odpowiedziami, czy uprzedzeniami. Sportowcy nawet po zdobyciu medalu olimpijskiego nie przestają trenować – ciągły rozwój jest częścią ich życia. Uczenie się to doświadczenie. Sportowiec musi przestrzegać zasad fair play. W świecie AI odpowiednikiem tego jest troska o transparentność, odpowiedzialne wykorzystywanie danych i eliminowanie dyskryminujących mechanizmów. Dobry trening to nie tylko dążenie do zwycięstwa, ale też do uczciwości – bo doping podważa sens rywalizacji.

AI – oprogramowanie komputerowe na sterydach?

Sztuczna inteligencja przyspiesza działanie tradycyjnego oprogramowania, wynosząc go na poziom, który jeszcze do niedawna był nieosiągalny. Można porównać AI do oprogramowania komputerowego na sterydach technologicznych. W medycynie stosowane w sposób odpowiedzialny sterydy – ratują życie, ale niszczą zdrowie – gdy są nadużywane. Czas to pieniądz, ale pośpiech jest złym doradcą. W erze AI zyskujemy czas, ale tracimy przestrzeń na refleksję. Tak jak doping w sporcie może prowadzić do utraty zdrowia, tak przyspieszony rozwój technologii AI niesie ryzyko społecznych skutków ubocznych. Brak przejrzystości w działaniu algorytmów, ryzyko dyskryminacji, uzależnienie od systemów AI, których sami nie rozumiemy – to koszty, które mogą okazać się wysokie. Tak jak doping potrafi wyniszczyć organizm, tak nadużywanie AI grozi wyniszczeniem więzi społecznych. Podobnie jak stosowanie „dopalaczy” może prowadzić do uzależnienia, tak samo człowiek może uzależnić się od AI.

Więcej na: www.liderzydostepnosci.pl/ngo-bez-barier/